A/B-testning ansågs av många vara enkelt: skicka besökare till testet och lite senare spottar verktyget ut ett testresultat. Var testning någonsin så enkelt? Nja. Och nu har Optimizely och Visual Website Optimizer dessutom startat en fajt om vem som har den bästa statistikmotorn.

De två vanligaste verktygen för A/B-testning, Optimizely och Visual Website Optimizer (VWO), har under det senaste halvåret släppt nya statistiska beräkningsmodeller – StatsEngine (Optimizely) och SmartStats (VWO). Varför? De kunde se att många användare tjuvkikade på pågående test och tog förhastade slutsatser. Båda vill hjälpa användare att ta bättre beslut.

Behöver du ta ställning till det? Ja, eventuellt. När båda leverantörerna har hela avsnitt av sina sajter dedikerade till att förklara hur just deras statistik-motor fungerar och varför den är bäst, vet du att något har hänt.

Vi har alltså fått tre NYA frågor vi ska ta ställning till när vi ska välja A/B-testningsverktyg:

- Vad är skillnaden mellan Optimizely och VWO?

- Har skillnaden någon betydelse?

- Vilket verktyg ska jag välja?

Resten av den här artikeln kommer att handla om hur vi ska förhålla oss till de nya faktat och vilka beslut vi som online-ansvariga och marknadsförare ska fatta.

1 Vad är skillnaden mellan Optimizely och VWO?

Den här frågan handlar om hur mycket vi måste sätta oss in i hur A/B-testningsverktygen faktiskt fungerar ”behind the scenes”.

Antingen ser vi det hela som en svart låda. Vi är helt ok med att vi inte har någon aning om hur lådan fungerar. Vi litar på att de som har gjort lådan vet vad de håller på med och att lådan ger oss tillförlitliga resultat – speciellt nu när båda verktygen hanterat problemet med ”tjuvkikning”.

Eller så tycker vi att det är viktigt med någon slags grundläggande förståelse för hur de algoritmer som bestämmer framgång eller fiasko för våra A/B-tester faktiskt fungerar.

Om du tillhör den första kategorin av online-verksamma så kan du sluta läsa nu. Tack så mycket för att du orkade läsa ända hit.

Om du tillhör den andra kategorin hoppas vi att vi kan ge dig lite nya insikter och kanske förståelse för fallgropar och fördelar med de olika av testningsverktygen och deras statistik-funktioner.

Svarta lådan enligt Optimizely

Jag var på plats när Dan Siroker, grundare och VD, presenterade StatsEngine på Opticon i San Francisco i våras. Hans huvudbudskap var:

”Vi har lyssnat på er, våra användare, och ni har sagt att ni vill kunna se testresultatet löpande genom hela testet och ni vill kunna sätta flera testmål. Vi tänker inte försöka omvända er till att arbeta på något annat sätt, så vi har anpassat vår statistik-funktion så att den stödjer hur ni vill arbeta.”

Svarta lådan enligt VWO

VWO har en lite mer hard-core approach och tvingar dig som testare att välja ETT primärt testmål. De har också en annan statistisk modell som bl.a. hanterar problemet med att ”tjuvkika på testresultaten” på ett annorlunda sätt mot vad Optimizely gjort.

De har alltså inte ”lyssnat på sina användare” lika mycket som Optimizely gjort. I stället har man valt en väg som är mer metod-mässigt korrekt. Like it or not.

För att förstå varför de gjort så måste man förstå vad som blir effekten av att tjuvkika och att sätta flera testmål.

Varför det är fult (och dumt) att tjuvkika.

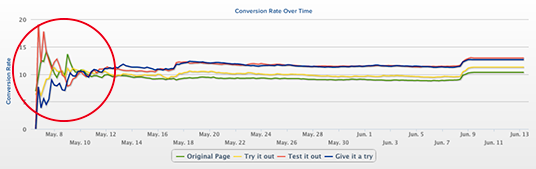

När urvalet är litet kan slumpmässiga variationer få ett stort genomslag. Och det betyder att det är dumt att tjuvkika eftersom testresultatet kommer bero på NÄR du stoppar testet.

Det är till och med så att ett test kan visa ett signifikant resultat för A och sedan ett signifikant resultat för B. Se den här filmen som visar hur det kan gå till i verkliga livet:

André Morys – The million Dollar Optimisation strategy @ Conversion Jam 5

Hur förhåller sig Optimizely och VWO till tjuvkikning?

Båda har angripit problemet, men på olika sätt.

- Optimizely: Du kan tjuvkika och se testresultaten. Men du kommer inte se statistisk signifikans förens den är pålitlig – baserat på sample-storleken.

- VWO: Du kan tjuvkika och se testresultaten. Det är här dock inte ett problem i samma utsträckning då deras statistiska modell hanterar problemet annorlunda.

Varför det kan vara dumt att sätta flera testmål.

Det verkar ju smidigt att inte på förhand behöva gissa vilket som ska vara det mest utslagsgivande mätetalet, men det medför risker som en kanske inte tänker på.

Om du har flera testmål så kommer den statistiska variationen öka chansen att NÅGOT av testmålen uppnår statisk signifikans, som en följd av ren slump.

Låt oss ta ett exempel. Om du sätter upp ett test med 95% signifikans och tio olika testmål så kommer du ha 40% chans att ett av alla testmål visar ett positivt resultat, bara som en följd av ren slump.

Hur förhåller sig Optimizely och VWO till flera testmål?

- Optimizely: Låter dig sätta upp flera testmål för att sedan avgöra vilket eller vilka du vill använda för att avgöra testvinnaren. Medförd en risk alltså.

- VWO: Tvingar dig att sätta upp ETT primärt testmål som kommer att avgöra testet. Du kan sätta flera, med de hanteras som separata test och medför inte samma risk.

Fundamental olika syn på statistik

När vi avgör om våra A/B-tester vinner eller förlorar har vi hittills använt oss av en metod som kallas frekventistisk statistik (eller klassisk inferens-statistik). Den har funnits lång tid och använts inom allt från medicin till valprognoser och sport. A/B-testjättarna har nu jobbat ifrån den metoden och valt nya modeller:

- Optimizely: Deras statistik-motor använder fortfarande en form av frekventistisk statistik fast de genomför nu ”Sekventiell testning”, förmatad med fördefinierade testvärden.

- VWO: De har gått helt emot strömmen och valt att gå ifrån frekventistisk statistik och använder idag ”Bayesiansk statistik”.

Bayes… va? Lås oss fokusera på effekterna och så lämnar vi de matematiska termerna där.

Hur de själva förklarar sina statistik-motorer:

Optimizely: optimizely.com/statistics/

VWO: vwo.com/bayesian-ab-testing/

2 Har skillnaden någon betydelse?

Säg att du hittat på ett botemedel mot cancer. Nu vill testa hur troligt det är att din nya medicin fungerar bättre än andra alternativ eller mot alternativet – ingen medicin alls. Du sätter upp två kontrollgrupper; en grupp testar din medicin, och den andra får sockerpiller. Nu är den viktigaste uppgiften för dig som cancerforskare att: minimera risken att din nya medicin skulle vara det som kallas falskt positiv. Det betyder att det ser ut som att den nya medicinen fungerar bättre men i själva verket så är det bara en effekt av slumpen.

Tänk vad som skulle hända om du släppte ut den nya medicinen i stor skala och sedan visade det sig att den inte har någon effekt alls, eller till och med en negativ effekt! Det här vill du undvika till varje pris. Och därför är klassisk statistik gjord för att upptäcka och bedöma risken för att det resultat som du ser som positivt i själva verket är ett så kallat ”falskt positivt” resultat.

Nu är ju du inte cancerforskare så att minimera risken för falskt positiva resultat kanske inte är din viktigaste prioritering? Om det visar sig att du implementerat något som såg bättre ut i ett test, men det i själva verket hade ingen, eller negativ effekt – Hur dåligt är det på en skala? Kanske inte värre än alla andra oupptäckta konverteringsproblem som din sajt redan är fylld med utan att du vet om det?

Det för oss osökt vidare till den fråga du EGENTLIGEN vill ha svar på.

Här skiljer sig verktygen, igen.

VWO: Vad är sannolikheten att min nya version klår originalet?

Den stora förändringen som VWO alltså gjort är att de gått över till en helt ny statistisk beräkningsmodell byggd på Bayesiansk statistik. Och därför är det just denna fråga som VWO faktiskt svarar på. Aha – läge att gå All-in på VWO då, eller? Mja.

Optimizely: Vad är risken att min nya version är falskt positiv?

Den fråga som Optimizely besvarar, hänger ihop med VWOs svar. Ett resultat med hög sannolikhet (VWO) har också liten risk att vara falskt positiv (Optimizely).

Rörigt? Vi tar ett exempel.

Kommer solen att skina?

Du ska köra till landet över helgen. Du funderar på om du måste gå och köpa ett par solglasögon, om solen skulle skina.

Du frågar Optimizely: de svarar att det är mindre än 5% chans att solen kommer att skina.

Du frågar VWO: De svarar att sannolikheten att för mulet väder är 90%.

Du får två olika svar, men din slutsats är: – ”Jag behöver nog inte gå och köpa ett par solglasögon, det verkar bli mulet”.

Två svar, men samma beslut.

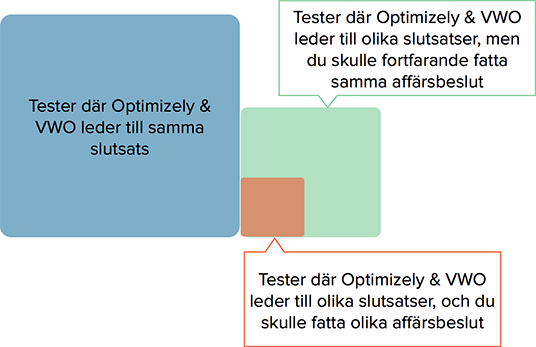

Om en försöker strukturera upp de olika möjliga utfallen inser man snart att det finns tre olika fall:

I många fall kommer Optimizely och VWO komma till samma slutsats. Om du har en riktigt bra eller riktigt dålig testhypotes kommer båda verktygen att upptäcka det.

3 Vilket verktyg ska jag välja?

I slutänden ska du ju också komma ihåg att det är fler saker än kraften i statistiken som avgör ditt verktygsval. Här är några av de faktorer som du måste ta hänsyn till:

- Priset i förhållande till din trafikvolym och ditt testningsbehov

- Integrationer med andra verktyg, tex analysverktyg

- Support

Och inte minst- Nu när du (förhoppningsvis) förstått vilka problem du kan springa på om du tjuvkikar och sätter många testmål – Fundera på hur din organisation kan och vill hantera det, och välj verktyg därefter.

Om du har flera testversioner:

I Optimizely kan du ändra vilken variation du vill betrakta som original, verktyget kommer alltid att jämföra dina testversioner mot originalet. Det gör att svaret på ditt test kommer t.ex. att vara ”Vad är risken att någon av variationerna B, C, D… falskt positivt klår originalet A?”

VWO kan jämföra versionerna mot varandra, alltså inte bara versionerna mot originalet. Det genom att ändra baseline eller byta variation för calculations. En stor skillnad om du testar flera versioner mot varandra samtidigt.

Så det är upp till dig att ranka dina faktorer, och fundera på vad som är viktigast för dig.

Sammanfattning

- Både Optimizely och VWO har hanterat problemet med tjuvkikning, men på olika sätt.

- Optimizely tillåter flera testmål vilket medför en (förhållandevis liten) risk.

- VWO har satsat på en mer avancerad statiskfunktion som ”låser in” aka ”hjälper” dig som testare mer.

- VWO svarar på en fråga som ligger närmare det du är intresserad av – ”Vad är sannolikheten för att min nya variation är bättre?” Optimizely svarar på en närbesläktad fråga som i dock i många fall leder till samma slutsats.

- VWO kan jämföra flera testversioner mot varandra, inte bara mot originalet som Optimizely gör.

OBS:

Det viktigaste är att komma igång att A/B-testa. Båda verktygen är bra.

Om du ännu inte börjat: 3 saker att börja A/B-testa

Som en avslutande cliff-hanger hävdar också VWO att de snabbare kommer fram till resultat, men det kommer vi avhandla i nästa bloggpost.

Är du förvirrad, men på en högre nivå?

Fortsätt då att följa våra uppdateringar, så kommer du att få löpande info på hur det går i matchen mellan A/B-testningsvärldens två tungviktare.